3/4 - "ChatGPT zei het" is geen bron | Costa Blanca

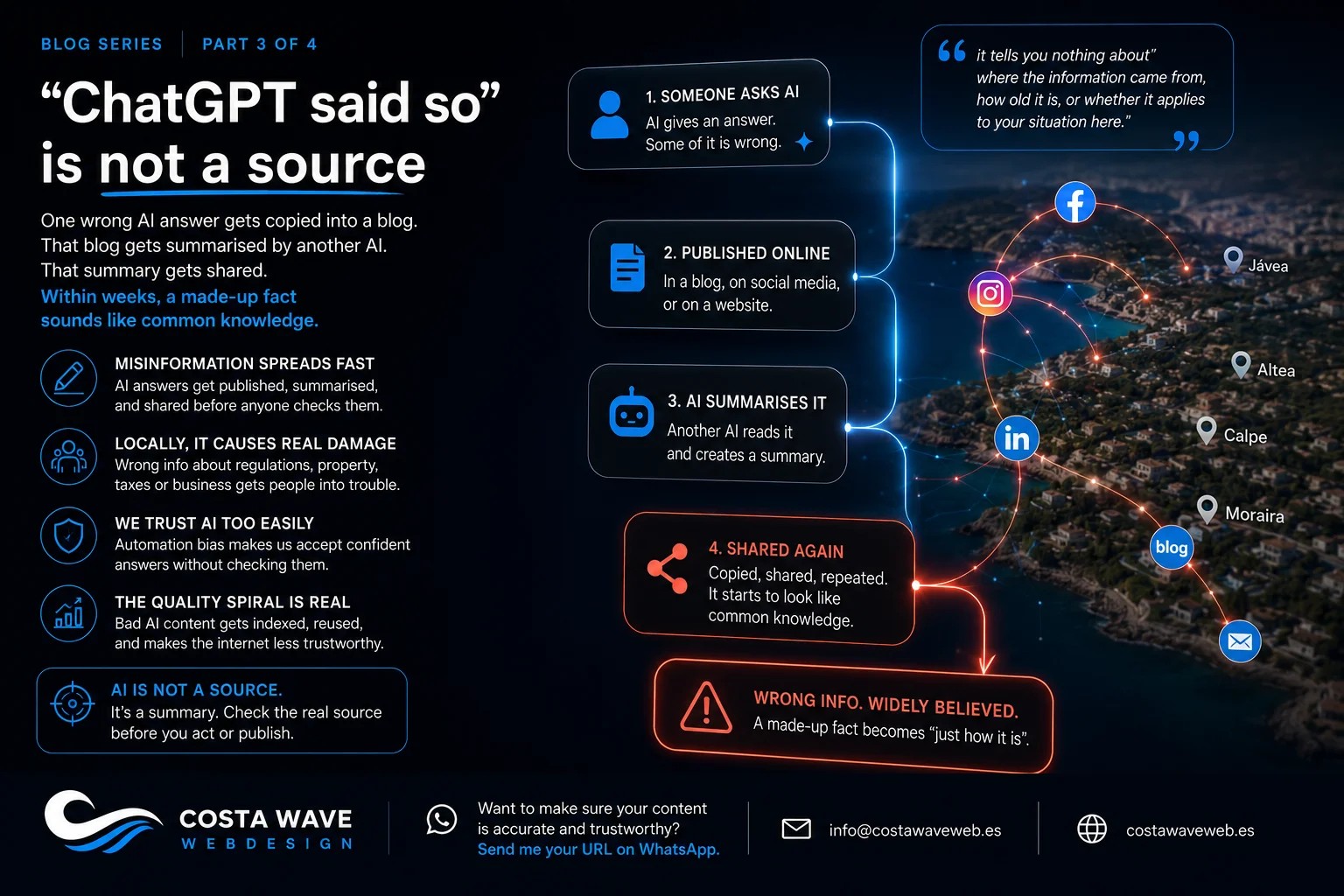

Eén fout AI-antwoord wordt gekopieerd in een blog. Die blog wordt samengevat door een andere AI. Die samenvatting wordt gedeeld. Binnen een paar weken klinkt een verzonnen feit als algemene kennis. Zo werkt dat.

"ChatGPT zei het" is geen bron

Er is iets veranderd in hoe mensen informatie delen.

Een paar jaar geleden zei iemand misschien "ik las het op een website." Daarna "ik zag het op Facebook." Nu hoor ik constant, van ondernemers in Calpe, van makelaars in Jávea, van mensen die een nieuw bedrijf beginnen in Altea en Moraira, deze zin:

"ChatGPT zei het."

Gezegd alsof daarmee de discussie gesloten is.

Hoe desinformatie zich verspreidt

Dit is hoe het in de praktijk werkt.

Iemand stelt een AI-tool een vraag. De AI produceert een antwoord. Een deel van dat antwoord is nauwkeurig. Een deel is ingevuld vanuit patronen, zoals we in het vorige artikel behandelden. De persoon controleert het niet. Ze publiceren het: in een blogpost, in een nieuwsbrief, in een Facebookgroep, op een websitepagina.

Iemand anders leest die content. Ze vragen een AI het samen te vatten. Die AI produceert een nieuwe versie, nu deels gebaseerd op de originele verkeerde informatie. Die versie wordt ook gedeeld.

Binnen een paar weken is de originele fout gekopieerd, samengevat en vaak genoeg herhaald dat het eruitziet als algemene kennis. Een statistiek die was verzonnen. Een regelgeving die hier niet van toepassing is. Een prijs die gebaseerd was op een ander land.

Het Stanford Cyber Policy Center heeft gedocumenteerd hoe AI-gegenereerde content de kosten van het produceren van desinformatie op grote schaal verlaagt. Content die voorheen teams van mensen kostte om te maken kan nu in seconden worden gegenereerd, en zodra het gepubliceerd is wordt het geïndexeerd, samengevat en gedeeld voordat iemand het controleert.

De lokale versie van dit probleem

Aan de Costa Blanca speelt dit op een heel specifieke manier.

Makelaars in Altea die AI-geschreven beschrijvingen van het aankoopproces in Spanje delen. Een deel van die informatie is nauwkeurig voor een algemene Europese markt. Een deel is niet nauwkeurig voor Spanje. Een deel is niet nauwkeurig specifiek voor de regio Valencia.

Ondernemers in Calpe die AI vragen om advies over lokale vergunningen, om dat advies dan als feit op hun website te zetten. Bezoekers in Benidorm die AI-gegenereerde recensies schrijven. Touroperators in Jávea die AI gebruiken om content te schrijven over lokale gebieden, zonder dat iemand die die gebieden echt kent het controleert.

Niemand van deze mensen probeert iemand te misleiden. Ze gebruiken een hulpmiddel dat betrouwbaar aanvoelt omdat het betrouwbaar klinkt. Dat is het probleem.

Als de verkeerde informatie over iets algemeens gaat, is de schade beperkt. Als het over de bouwregelgeving in Calpe gaat, over de verhuurvergunningsregels in Moraira, of over het specifieke proces voor het kopen van een woning in de regio Valencia, gaat iemand die het vanuit Amsterdam leest en van plan is hierheen te verhuizen beslissingen nemen op basis ervan.

Het "automation bias" probleem

Er is een naam voor wat er gebeurt als mensen AI-output meer vertrouwen dan ze zouden moeten.

NIST, het Amerikaanse National Institute of Standards and Technology, noemt het automation bias: de neiging om AI-gegenereerde content als beter of betrouwbaarder te beschouwen dan andere bronnen, simpelweg omdat een computer het produceerde.

NIST's AI Risk Management Framework documenteert dit als een van de voornaamste risico's van AI-systemen in praktisch gebruik. Mensen overschrijven hun eigen oordeel omdat de AI zo zelfverzekerd leek.

Het is om dezelfde reden dat de advocaat in New York in het vorige artikel de zaken die ChatGPT citeerde niet controleerde. Ze zagen er juist uit. De AI was zelfverzekerd. De instinct van de advocaat om te verifiëren werd overschreven door de aannemelijkheid van de output.

Dat gebeurt elke dag op kleine schaal. Een ondernemer in La Nucia leest een AI-antwoord over btw-regels en stopt daar. Een koper in Alfaz del Pi leest een AI-gegenereerde samenvatting van het aankoopproces en behandelt het als gids. Een nieuwkomer in Denia vraagt AI om advies over het opzetten van een bedrijf en volgt het op zonder een gestor te raadplegen.

SEO en de kwaliteitsspiraal

Er is een neveneffect dat iedereen raakt die een website heeft aan de Costa Blanca.

Wanneer grote hoeveelheden AI-gegenereerde content, deels nauwkeurig, deels niet, over het internet worden gepubliceerd, beginnen zoekmachines die content te indexeren. AI-systemen trainen dan op die content. Wat betekent dat de volgende generatie AI-modellen deels leert van content die al was gegenereerd door AI.

Google's documentatie over nuttige content behandelt dit specifiek: content die primair is gemaakt om pagina's te vullen in plaats van mensen echt te helpen krijgt lagere rankings. Dat geldt voor AI-gegenereerde content die zonder goede controle wordt gepubliceerd.

Het praktische resultaat voor lokale bedrijven: als jouw concurrenten hun websites vullen met ongecheckte AI-content en jij niet, wordt jouw site relatief betrouwbaarder in de ogen van Google. Dat is een voordeel dat het waard is te hebben.

Maar als jouw site ook ongecheckte AI-content bevat met verkeerde lokale details, verkeerde datums, of beweringen die niet te verifiëren zijn, raakt hij verstrikt in dezelfde neerwaartse spiraal.

Het verschil tussen een bron en een samenvatting

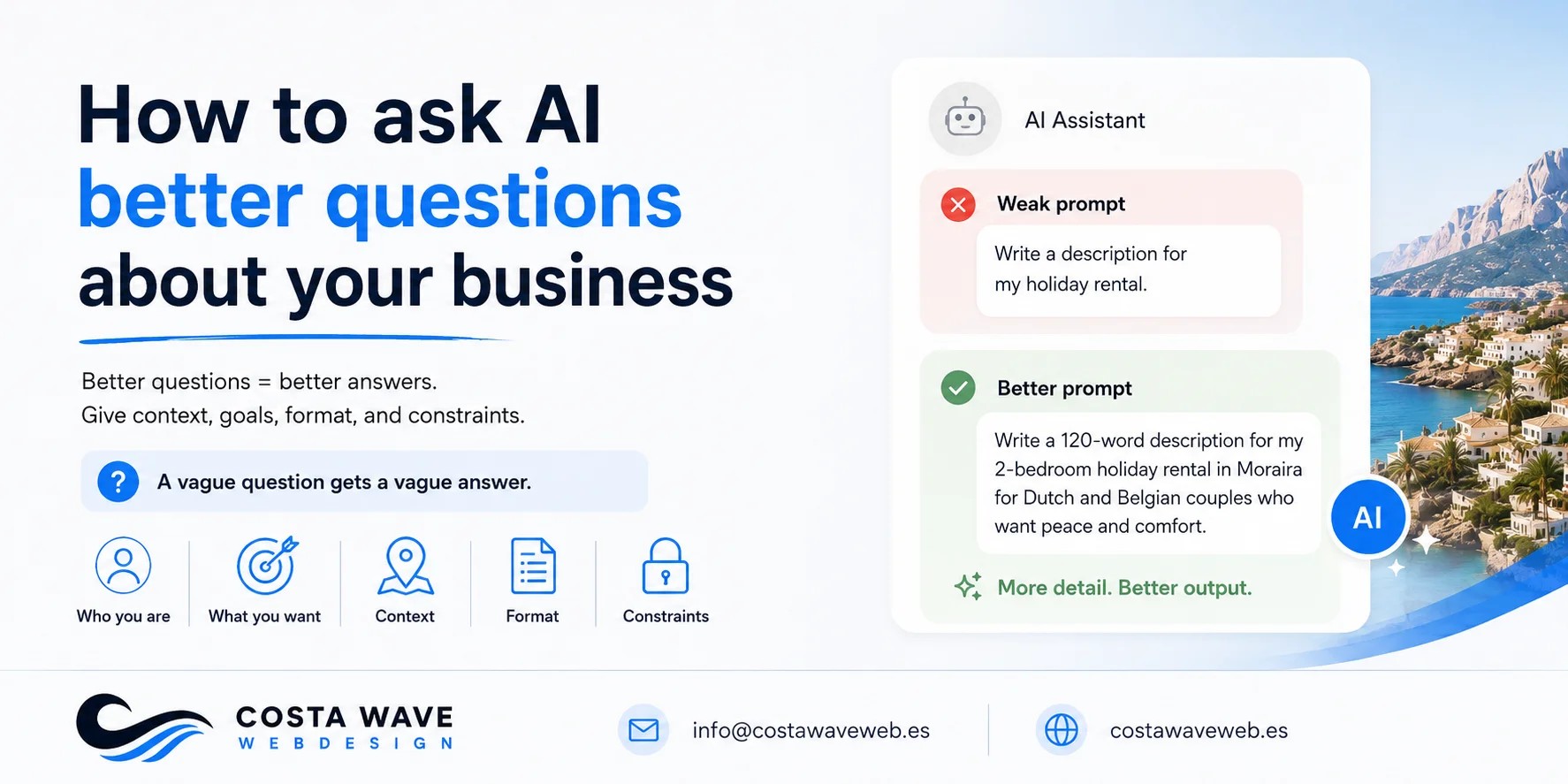

Dit is het praktische punt dat het meeste uitmaakt.

AI is geen bron. Het is een samenvatting van andere bronnen, gefilterd door een model dat soms gaten opvult met verzonnen content.

Een echte bron heeft een auteur. Een datum. Een locatie. Een publicatie. Iets waar je naar kunt wijzen en zeggen: hier komt deze informatie vandaan, dit is wanneer het werd geschreven, dit is wie het schreef, en dit is het land waarop het van toepassing is.

"ChatGPT zei het" heeft niets van dat alles. Het vertelt je niets over waar de informatie vandaan komt, hoe oud het is, of het van toepassing is op jouw situatie in Altea, Jávea of Calpe.

Dat betekent niet dat AI-output nutteloos is. Het betekent dat je het terug moet volgen naar een echte bron voordat je ernaar handelt of het publiceert.

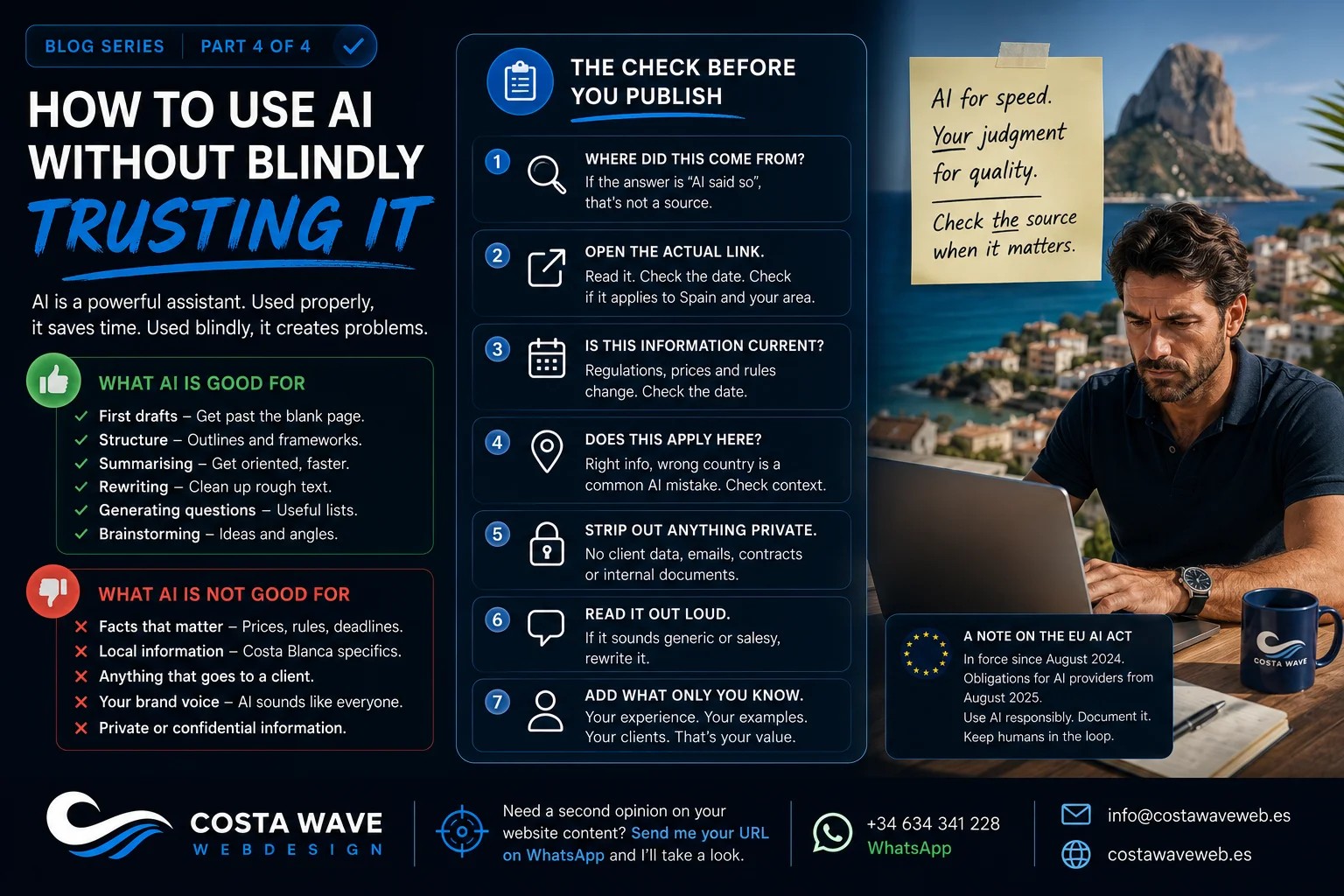

Het volgende en laatste artikel in deze serie gaat over hoe je dat in de praktijk doet: hoe je AI gebruikt op een manier die je tijd bespaart zonder het beslissingen voor je te laten nemen.

Lees deel 4: Zo gebruik je AI zonder er blind op te varen.

Als je wilt weten of de content op jouw website jouw reputatie in lokaal zoeken helpt of schaadt, stuur me je URL via WhatsApp en ik geef je een eerlijk antwoord.

Lees meer:

- Waarom AI overtuigend klinkt, ook als het fout zit

- AI liegt niet. Het vult gaten op.

- Moet je AI gebruiken voor je websiteteksten?

- Waar voldoet een goede website aan? De gids voor ondernemers aan de Costa Blanca

Blijf op de hoogte

Meld je aan en ontvang een berichtje als er een nieuw artikel online staat.