2/4 - AI liegt niet. Het vult gaten op. | Costa Blanca

AI weet niet wanneer het iets niet weet. Het vult de leemte op met wat aannemelijk klinkt. Dat is geen bug. Zo werkt de technologie. Dit is hoe dat eruitziet in de praktijk.

AI liegt niet. Het vult gaten op.

Er is een woord dat veel opduikt als mensen het hebben over AI die dingen fout doet.

Hallucinatie.

Het klinkt dramatisch. Alsof de AI dingen ziet die er niet zijn. Maar wat het echt betekent is veel gewoner, en juist daardoor gevaarlijker.

Wat hallucinatie echt betekent

NIST, het Amerikaanse National Institute of Standards and Technology, definieert het als confabulatie: AI produceert content die zelfverzekerd, vloeiend en fout is. Niet willekeurig fout. Aannemelijk fout. Fout op een manier die past bij hoe een correct antwoord eruit zou zien.

OpenAI heeft geschreven over waarom dit gebeurt. Modellen kunnen worden getraind op manieren die het produceren van een antwoord belonen boven het toegeven van onzekerheid. Dus als het model geen betrouwbare informatie heeft, zegt het dat niet altijd. Het produceert iets wat klinkt als een antwoord.

Het resultaat is een hulpmiddel dat gaten opvult op dezelfde manier als alles andere: soepel, zelfverzekerd, zonder te melden dat er iets anders is.

Hoe het eruitziet in de praktijk

Een advocaat in New York diende in 2023 een juridisch stuk in bij een rechtbank. Het stuk citeerde meerdere rechtszaken als precedenten.

De zaken bestonden niet.

ChatGPT had ze gegenereerd. Echte namen. Echte zaaknummers. Echte samenvattingen. De advocaat had het niet gecontroleerd. De rechter merkte het op. De advocaat werd beboet.

De zaak werd uitgebreid besproken door de New York Times en werd een van de meest gerapporteerde voorbeelden van AI-hallucinatie die echte schade veroorzaakte.

Dat is een extreem geval. Maar hetzelfde gebeurt op veel kleinere schaal elke dag.

Een ondernemer vraagt AI naar de gemiddelde prijs van webdesign in Spanje. AI produceert een getal. Het klinkt specifiek. Het kan gebaseerd zijn op Britse prijzen, op data van 3 jaar geleden, of op niets in het bijzonder.

Iemand vraagt naar de regels rondom het in dienst nemen van personeel in Spanje. AI geeft een gedetailleerd antwoord. Zelfverzekerd. Gestructureerd. Gebaseerd op een mix van algemeen Europees arbeidsrecht en wat het verder relevant vond in de trainingsdata.

Iemand vraagt naar de openingstijden van een specifiek bedrijf aan de Costa Blanca. AI geeft openingstijden. Ze kunnen kloppen. Ze kunnen uit een vermelding komen die 2 jaar niet is bijgewerkt.

In elk geval leest het antwoord hetzelfde, of het nu nauwkeurig is of verzonnen.

Neppbronnen zijn een specifiek probleem

AI verzint niet alleen feiten. Het verzint ook bronnen.

Vraag het een bewering te onderbouwen met een referentie en het produceert soms een citaat dat er volledig echt uitziet: een aannemelijke naam van de auteur, een aannemelijk tijdschrift, een aannemelijke titel, een aannemelijk jaar. Klik op de link en het artikel bestaat niet.

Dit is bijzonder gevaarlijk omdat een bron aanvoelt als bewijs. Je ziet een citaat en je waakzaamheid daalt. Je stopt met kritisch lezen. Dat is het moment waarop de verzonnen informatie erdoorheen glipt.

De regel is eenvoudig: als een bron ertoe doet, open hem zelf. Vertrouw de titel niet. Vertrouw de samenvatting niet. Open de werkelijke pagina, controleer de datum, controleer de auteur, controleer of het zegt wat de AI beweerde dat het zegt.

Waarom het vaker voorkomt met lokale informatie

AI werd getraind op tekst van over het hele internet. Een groot deel van die tekst is in het Engels en behandelt de VS, het VK en West-Europa in het algemeen.

Lokale informatie, specifieke regelgeving voor bedrijven in Spanje, vastgoedrecht aan de Costa Blanca, belastingregels voor zelfstandigen in de regio Valencia, is ondervertegenwoordigd. Er is minder van in de trainingsdata. Dat betekent dat het model minder heeft om op te bouwen en eerder gaten vult met algemene kennis die lokaal misschien niet van toepassing is.

Dit is het patroon dat ik het vaakst zie: iemand gebruikt AI om iets te onderzoeken dat specifiek is voor Spanje of de Costa Blanca, en het antwoord dat ze krijgen gaat technisch gezien over Europa, of erger, over een heel ander land.

Het leest correct. De context is verkeerd.

Het ding dat dit moeilijk te zien maakt

Als AI "ik weet het hier niet zeker van" zei voor elk antwoord waarover het onzeker was, zou hallucinatie gemakkelijk te beheren zijn.

Dat doet het niet.

Het onzekere antwoord en het zelfverzekerde antwoord zien er identiek uit. De verzonnen bron en de echte bron zien er identiek uit. De regelgeving van het verkeerde land en die van het juiste land zien er identiek uit.

Je kunt het niet zien aan de tekst zelf. Je moet controleren.

Dat is geen kritiek op AI als hulpmiddel. Het is gewoon de realiteit van hoe het nu werkt. En dat weten verandert hoe je het zou moeten gebruiken.

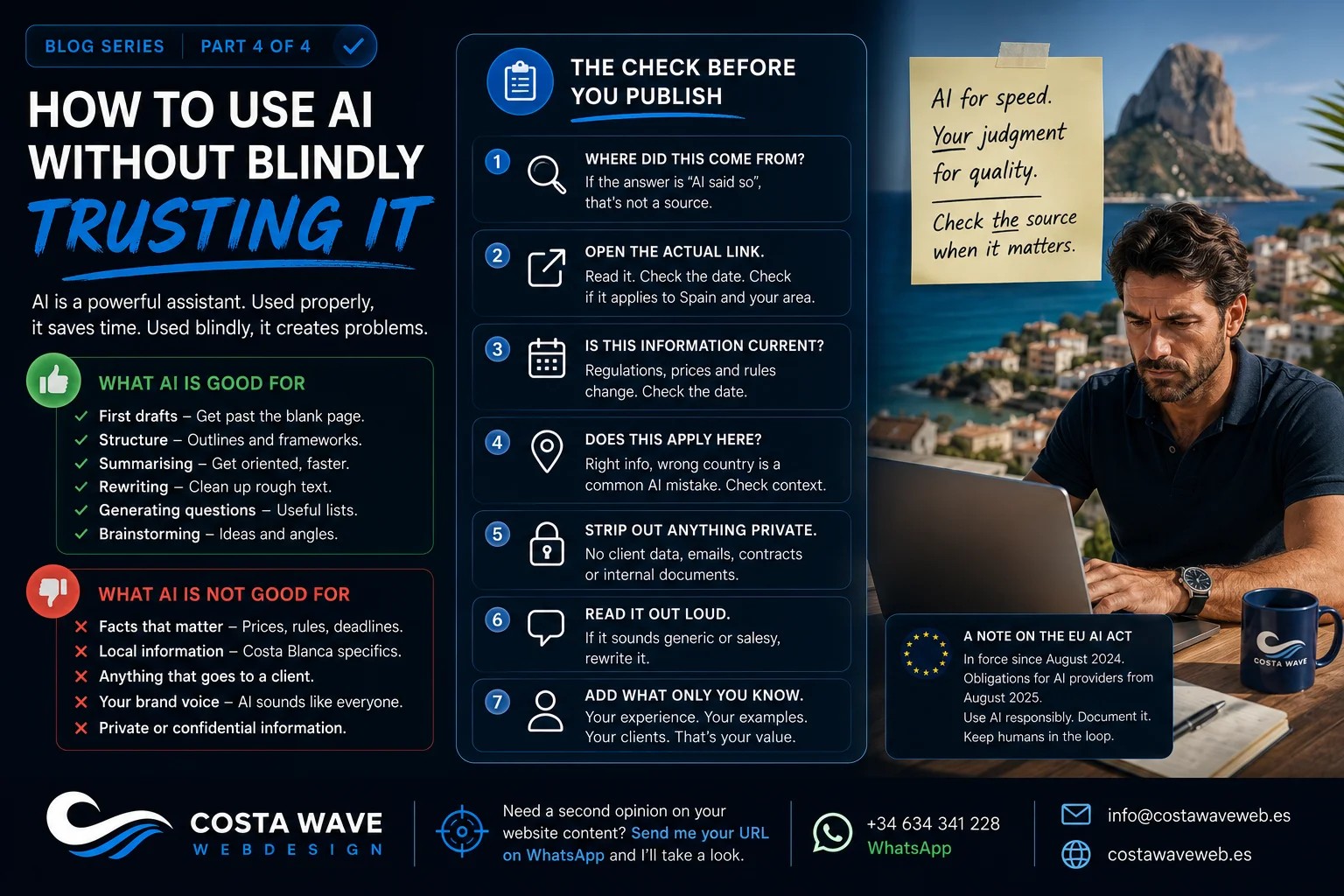

Wat je eraan kunt doen

Controleer alles wat ertoe doet. Dat betekent:

Prijzen: kijk naar actuele bronnen die specifiek zijn voor Spanje. Juridische en belastingregels: check bij een professional of een geverifieerde Spaanse overheidsbron. Bronnen en citaten: open elke link voordat je hem vertrouwt. Lokale bedrijfsinformatie: controleer rechtstreeks bij het bedrijf. Statistieken: zoek de originele studie, niet de AI-samenvatting.

AI is nog steeds nuttig voor structuur, voor concepten, voor het genereren van ideeën, voor het herschrijven van ruwe tekst. Voor die dingen telt de exacte nauwkeurigheid van elke bewering minder.

Maar voor alles wat op je website komt, in een contract gaat, in advies aan een klant, of in een beslissing die geld kost: controleer het onafhankelijk.

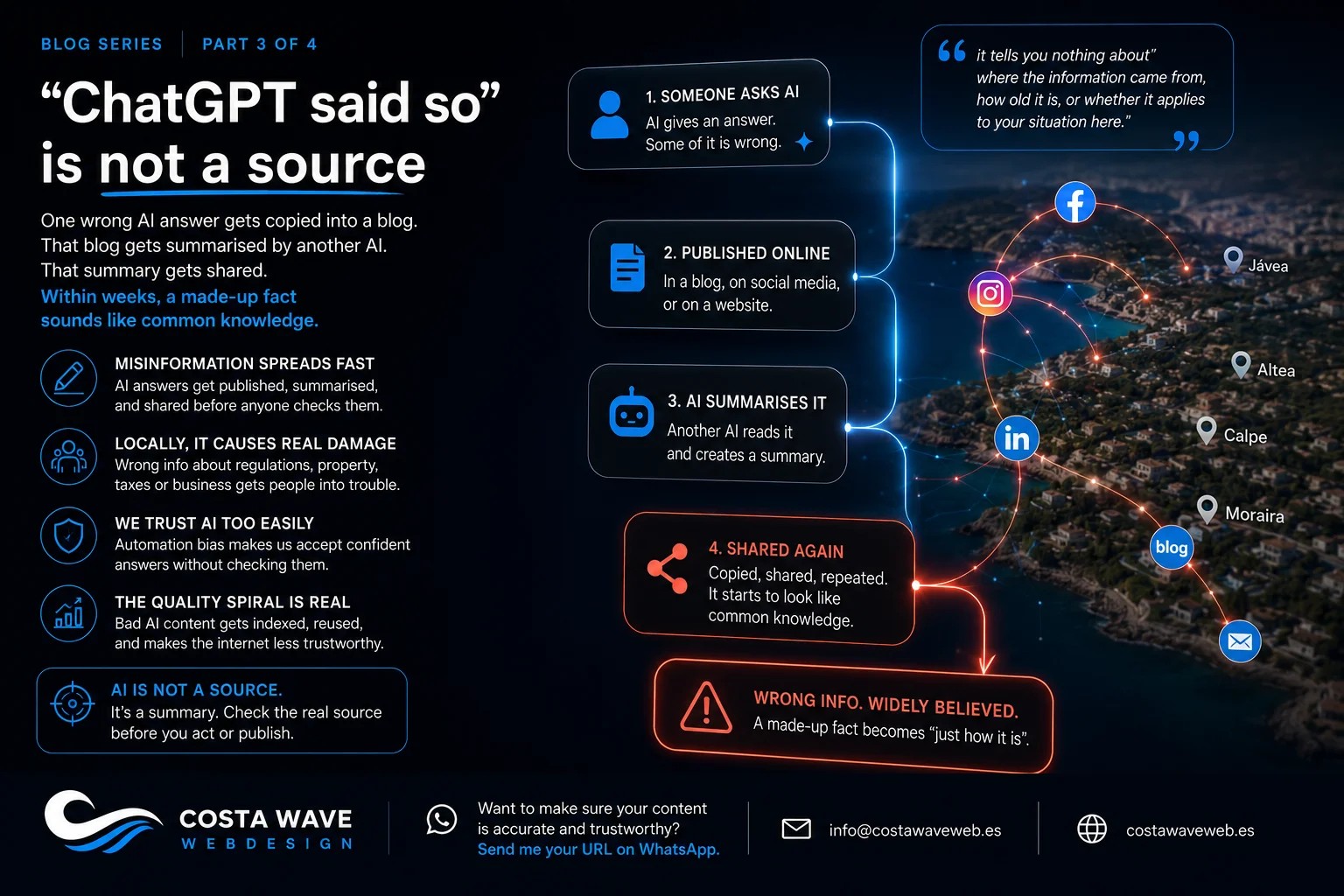

Het volgende artikel gaat over wat er gebeurt als AI-gegenereerde desinformatie niet op één plek blijft. Hoe het zich verspreidt, hoe het wordt versterkt, en waarom "ChatGPT zei het" een zin is die je voorzichtiger zou moeten maken, niet minder.

Lees deel 3: "ChatGPT zei het" is geen bron.

Als je wilt weten of de content op jouw website te vertrouwen is, stuur me je URL via WhatsApp en ik kijk er naar.

Lees meer:

- Waarom AI overtuigend klinkt, ook als het fout zit

- Moet je AI gebruiken voor je websiteteksten?

- Waarom een AI-website geen klanten oplevert

- Lokale SEO voor de Costa Blanca: wat echt werkt in 2026

Blijf op de hoogte

Meld je aan en ontvang een berichtje als er een nieuw artikel online staat.